作者注:详细对比GPT-4o、GPT-4.1及其Mini/Nano变体的API定价策略,提供成本优化选择建议

选择合适的AI模型API定价方案一直是开发者关心的问题。本文将对比 GPT-4o API价格 和 GPT-4.1系列价格 的优缺点。

通过输入输出Token成本、上下文容量、性能表现等维度的详细分析,帮你找到最适合的 GPT-4o API价格对比选择策略。

核心价值:看完本文,你将明确知道不同预算和使用场景下该选择哪个API定价方案,避免选择错误浪费成本。

GPT-4o API价格对比 背景介绍

OpenAI在2025年推出GPT-4.1系列模型后,AI模型API定价竞争进入新阶段。与GPT-4o相比,GPT-4.1系列提供了更多价格选择,从企业级的标准版到超低成本的Nano版。

当前 GPT-4o API价格对比 现状

价格差异显著:GPT-4.1标准版比GPT-4o便宜20%,而GPT-4.1 Nano版的成本仅为GPT-4o的4%

功能取舍明确:GPT-4o主打多模态能力,GPT-4.1系列专精文本和代码任务

这种差异化定位让开发者在 GPT-4o API价格对比 选择中面临重要的成本效益权衡。

GPT-4o API价格对比 核心定价结构

以下是 GPT-4o API价格对比 的详细定价矩阵:

📊 完整价格对比表(每百万Token)

| 模型名称 | 输入Token价格 | 输出Token价格 | 上下文窗口 | 主要特点 |

|---|---|---|---|---|

| GPT-4o | $2.50 | $10.00 | 128K | 多模态支持,实时交互 |

| GPT-4o Mini | $0.15 | $0.60 | 128K | 预算友好,保持128K上下文 |

| GPT-4.1 | $2.00 | $8.00 | 1M | 超长上下文,编程专精 |

| GPT-4.1 Mini | $0.40 | $1.60 | 1M | 比GPT-4o便宜83%,强编程能力 |

| GPT-4.1 Nano | $0.10 | $0.40 | 1M | 最低价格,保持1M上下文 |

💰 成本节省对比分析

GPT-4.1标准版优势:

- 输入Token便宜20%($2.50 → $2.00)

- 输出Token便宜20%($10.00 → $8.00)

- 上下文容量提升约8倍(128K → 1M)

Mini/Nano版本优势:

- GPT-4.1 Mini比GPT-4o便宜83%

- GPT-4.1 Nano比GPT-4o便宜96%

- 保持1M超长上下文能力

GPT-4o API价格对比 应用场景分析

不同的 GPT-4o API价格对比 方案适合不同使用场景:

🎯 场景1:多媒体处理应用

推荐选择:GPT-4o 或 GPT-4o Mini

适用情况:

- 需要处理图像、音频、视频内容

- 实时交互应用(聊天机器人、语音助手)

- 消费级产品快速原型开发

成本计算:

GPT-4o标准版:每100万输入+输出Token = $12.50

GPT-4o Mini:每100万输入+输出Token = $0.75

💻 场景2:大规模文档处理

推荐选择:GPT-4.1 或 GPT-4.1 Mini

适用情况:

- 处理长文档(超过128K tokens)

- 代码库分析和重构

- 企业级文档总结和分析

成本计算:

GPT-4.1标准版:每100万输入+输出Token = $10.00

GPT-4.1 Mini:每100万输入+输出Token = $2.00

节省成本:相比GPT-4o标准版可节省20-84%

🚀 场景3:高频调用成本敏感应用

推荐选择:GPT-4.1 Nano

适用情况:

- 大规模批量处理任务

- 初创公司预算有限

- 内容生成和简单对话应用

成本计算:

GPT-4.1 Nano:每100万输入+输出Token = $0.50

相比GPT-4o节省96%成本

GPT-4o API价格对比 技术实现

🛠️ 成本优化实现策略

策略1:混合模型使用

# 根据任务复杂度选择不同模型

def choose_model_by_task(task_type, context_length):

if task_type == "multimodal":

return "gpt-4o-mini" if budget_limited else "gpt-4o"

elif context_length > 128000:

return "gpt-4.1-nano" if simple_task else "gpt-4.1"

else:

return "gpt-4.1-mini" # 最佳性价比选择

# 成本估算函数

def estimate_cost(input_tokens, output_tokens, model):

pricing = {

"gpt-4o": {"input": 2.50, "output": 10.00},

"gpt-4o-mini": {"input": 0.15, "output": 0.60},

"gpt-4.1": {"input": 2.00, "output": 8.00},

"gpt-4.1-mini": {"input": 0.40, "output": 1.60},

"gpt-4.1-nano": {"input": 0.10, "output": 0.40}

}

cost = (input_tokens * pricing[model]["input"] +

output_tokens * pricing[model]["output"]) / 1000000

return cost

策略2:Token使用优化

# Token使用优化技巧

class TokenOptimizer:

def __init__(self, model_name):

self.model = model_name

def optimize_prompt(self, text):

"""优化输入文本减少Token消耗"""

# 移除不必要的空格和格式

cleaned = re.sub(r'\s+', ' ', text.strip())

# 使用简洁表达

optimized = self.replace_verbose_phrases(cleaned)

return optimized

def batch_process(self, texts, batch_size=10):

"""批量处理减少API调用次数"""

results = []

for i in range(0, len(texts), batch_size):

batch = texts[i:i+batch_size]

combined_prompt = "\n---\n".join(batch)

result = self.call_api(combined_prompt)

results.extend(result.split("---"))

return results

📈 实际成本计算示例

案例1:企业文档分析系统

需求:每天处理1000篇文档,平均每篇50K tokens输入,20K tokens输出

# 日处理量

daily_input_tokens = 1000 * 50000 # 5000万tokens

daily_output_tokens = 1000 * 20000 # 2000万tokens

# 不同模型月成本对比(30天)

models_monthly_cost = {

"gpt-4o": (50 * 2.50 + 20 * 10.00) * 30 = $9750,

"gpt-4.1": (50 * 2.00 + 20 * 8.00) * 30 = $7800,

"gpt-4.1-mini": (50 * 0.40 + 20 * 1.60) * 30 = $1560

}

# 成本节省:

# GPT-4.1 vs GPT-4o: 节省20% ($1950/月)

# GPT-4.1 Mini vs GPT-4o: 节省84% ($8190/月)

案例2:聊天机器人应用

需求:每天10万次对话,平均每次500 tokens输入,200 tokens输出

# 日处理量

daily_input_tokens = 100000 * 500 # 5000万tokens

daily_output_tokens = 100000 * 200 # 2000万tokens

# 月成本对比(考虑多模态需求)

chatbot_monthly_cost = {

"gpt-4o": (50 * 2.50 + 20 * 10.00) * 30 = $9750,

"gpt-4o-mini": (50 * 0.15 + 20 * 0.60) * 30 = $585,

"gpt-4.1-nano": (50 * 0.10 + 20 * 0.40) * 30 = $390

}

# 如果不需要多模态,GPT-4.1 Nano可节省96%成本

GPT-4o API价格对比 最佳实践

✅ 成本优化最佳实践

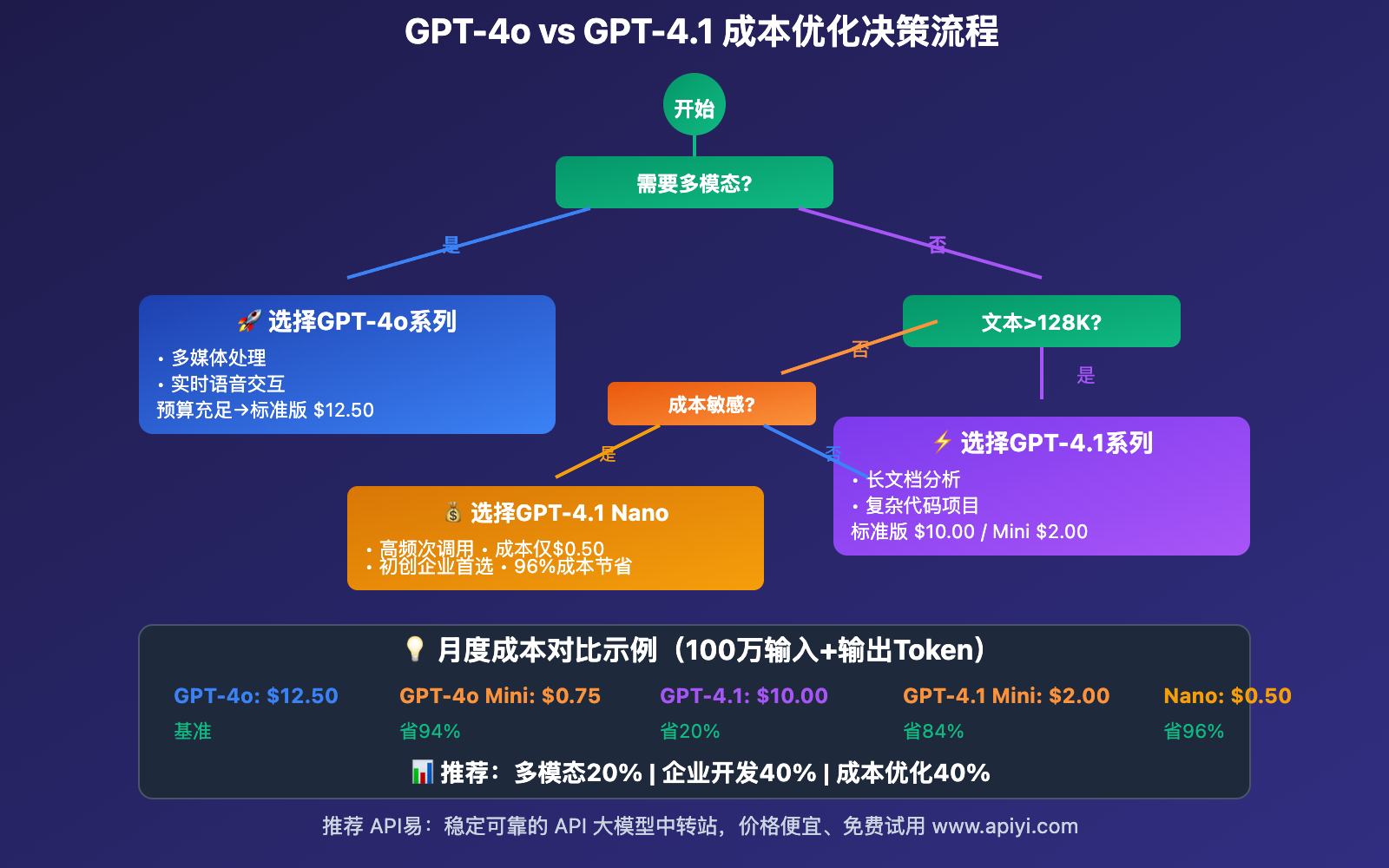

1. 模型选择决策框架

流程图:

需要多模态? → 是 → 预算充足? → 是 → GPT-4o

→ 否 → GPT-4o Mini

→ 否 → 文本超128K? → 是 → 复杂任务? → 是 → GPT-4.1

→ 否 → GPT-4.1 Mini

→ 否 → 成本敏感? → 是 → GPT-4.1 Nano

→ 否 → GPT-4.1 Mini

2. 成本监控策略

- 设置预算告警:月度API使用超过预设阈值时自动切换到更便宜的模型

- 实时成本跟踪:记录每个API调用的成本,分析高消耗场景

- A/B测试对比:在保证效果的前提下测试不同模型的成本效益

3. Token使用优化

- 输入优化:移除冗余信息,使用简洁表达

- 输出控制:设置合理的max_tokens参数避免过长响应

- 批量处理:合并多个简单任务减少API调用次数

📊 ROI计算公式

def calculate_roi(current_model, new_model, monthly_tokens):

"""计算切换模型的投资回报率"""

current_cost = calculate_monthly_cost(current_model, monthly_tokens)

new_cost = calculate_monthly_cost(new_model, monthly_tokens)

monthly_savings = current_cost - new_cost

annual_savings = monthly_savings * 12

# 考虑切换成本(开发、测试、部署)

switch_cost = 5000 # 估算切换成本

if annual_savings > switch_cost:

roi_months = switch_cost / monthly_savings

return f"建议切换,{roi_months:.1f}个月回本"

else:

return "暂不建议切换"

GPT-4o API价格对比 常见问题

❓ 定价策略FAQ

Q: GPT-4.1比GPT-4o便宜,性能会差很多吗?

A: GPT-4.1在文本和代码任务上性能更强,只是不支持多模态。如果你的应用不需要处理图像、音频、视频,GPT-4.1是更好的选择。

Q: Mini和Nano版本会影响响应质量吗?

A: 会有轻微影响,但对于大多数应用来说质量差异可接受。建议先用Mini版本测试,如果效果满足需求就不必使用标准版。

Q: 如何预估我的应用每月API成本?

A: 使用公式:月成本 = (月输入tokens × 输入价格 + 月输出tokens × 输出价格) ÷ 1000000

Q: 可以在同一个应用中混用多个模型吗?

A: 完全可以!智能路由是最佳实践:简单任务用Nano,复杂任务用标准版,多模态任务用GPT-4o。

🔧 技术实现FAQ

Q: 如何实现自动模型选择?

A: 建议基于任务类型、Token长度、预算限制等条件实现动态模型选择逻辑。

Q: 批量处理能节省多少成本?

A: 通过合并请求,通常可以减少20-30%的总Token消耗,特别是对于简单的分类或总结任务。

GPT-4o API价格对比 扩展阅读

📚 深度学习资源

- 成本优化策略:《AI模型API成本控制实战指南》

- 性能评测:《GPT-4.1 vs GPT-4o 综合性能基准测试》

- 企业应用:《大规模AI应用的成本预算与规划》

🛠️ 相关工具推荐

- 成本计算器:OpenAI官方API定价计算器

- 监控工具:API使用情况实时监控仪表板

- 优化框架:智能模型选择和Token优化库

总结

GPT-4o API价格对比分析显示,GPT-4.1系列在成本效益方面具有显著优势,特别是对于不需要多模态功能的应用。

🎯 核心要点回顾

- 价格优势明显:GPT-4.1系列比GPT-4o便宜20-96%

- 功能针对性强:GPT-4.1专精文本和代码,GPT-4o主打多模态

- 选择策略清晰:根据功能需求和预算限制选择合适版本

- 优化空间巨大:通过智能路由和Token优化可进一步降低成本

💡 最终建议

- 多模态应用:选择GPT-4o Mini实现成本与功能平衡

- 企业文档处理:首选GPT-4.1 Mini,性价比最优

- 高频简单任务:GPT-4.1 Nano是最经济的选择

- 混合策略:根据任务复杂度动态选择模型,最大化ROI

正确的 GPT-4o API价格对比 选择不仅能显著降低运营成本,还能为业务扩展提供更大的灵活性。建议从小规模测试开始,逐步优化模型选择策略。

作者:API易技术团队 | 专注于AI模型API服务优化与成本控制解决方案